在運營商家寬業務支撐場景中�,存在多個APP和系統需要與裝維人員交互����,傳統的功能按鈕點擊型操作交互界面�,越來越難以滿足裝維人員工作提效的迫切需求�����。家寬施工調度系統所需的AI語音能力主要包括ASR(音轉字)和TTS(字轉音)���。主要有以下幾點訴求:高效的語音轉錄�、語音角色分離���、生動的語音合成�����。

針對工業語音應用的單一化���,AI語音模型還應該可以通過微調的方式定制屬于自己的語言類別����,比如各個地市的方言�。

目前市面上開源的語言模型有很多��,比較著名的有OpenAI提供的Whisper模型�,Facebook AI 提出的wav2vec 2.0模型���,FunAudioLLM的SenseVoice語音識別模型和CosyVoice語音合成模型����,還有阿里達摩院開源的大型端到端語音識別框架FunASR���?;跇I務的技術能力需求���,結合市面上的多個語言模型各自的特點���,在保證語音識別質量的前提下����,推理速度更快的FunASR更為適合�����。

FunASR語音識別框架提供多種功能�����,包括語音識別(ASR)����、語音端點檢測(VAD)�����、標點恢復�、說話人分離和多人對話語音識別等�����。TTS模型選擇有著出色音色復制功能的CosyVoice模型��,實測發現在使用預訓練模型推理時�����,CosyVoice有著良好的性能表現�。

1.工業級模型: 基于超過60,000小時的中文數據和50,000小時的英文數據進行訓練�����,確保提供卓越的識別精度����。

2.實時與非實時解決方案:支持非實時的精準識別與實時應用場景的快速響應���,滿足多樣化需求���。

3.模塊化架構設計:用戶可以根據具體需求靈活選擇和定制模塊����,如集成VAD�����、PUNC模型����,從而提升應用的整體功能���。

原理淺析:高效算法與靈活擴展性的無縫融合

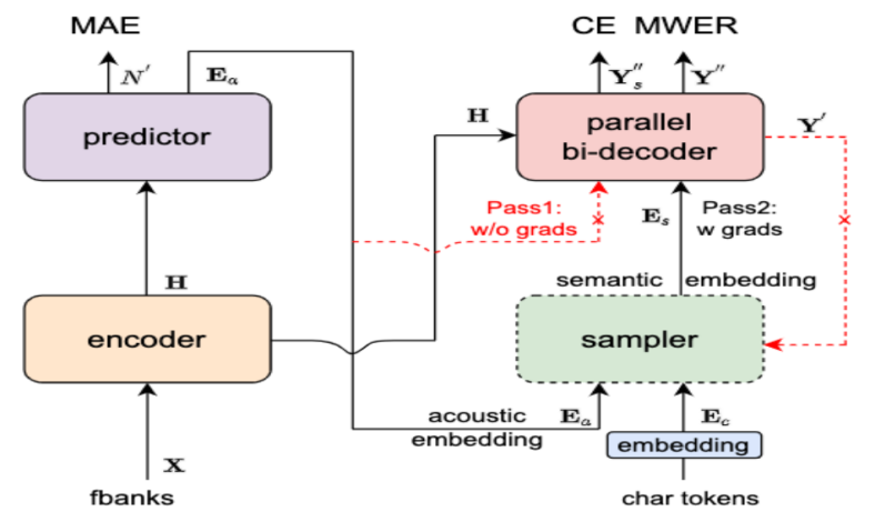

工具包的核心模型是Paraformer�����,這是一種高效的非自回歸端到端語音識別模型���,模型結構如下圖所示���。

來源于Modelscope Paraformer

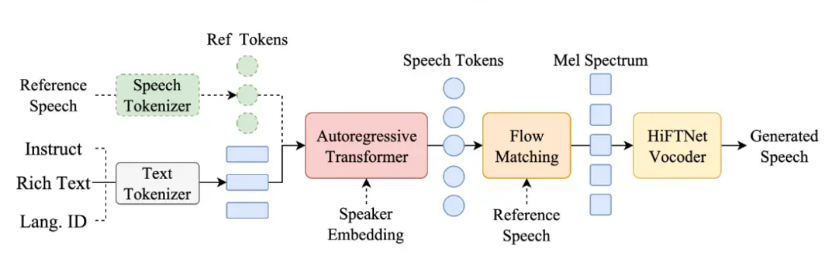

傳統到革新:語音合成技術的演變

傳統的TTS技術依賴于大量錄音數據和復雜的特征工程�����,而CosyVoice另辟蹊徑����,它是基于大型語言模型(LLM)和監督語義令牌來生成語音��,這些令牌與傳統的無監督學習得到的令牌不同���,它們能夠更準確地捕捉到語義信息����,并與文本對齊���。模型結構圖如下:

來源于Modelscope CosyVoice

核心亮點:開啟零樣本語音合成的全新時代

1.CosyVoice-300M:基座模型��,僅僅需要3至10秒的原始音頻就可以生成音色克隆��,甚至涵蓋韻律���、情感等細微的方面�,包括跨語種語音的生成�����。

2.CosyVoice-300M-SFT:微調版本����,經過專門的數據集微調以提高特定任務或領域的語音生成質量�。

3.CosyVoice-300M-Instruct:支持細粒度控制�����,包括對說話人身份����、說話風格(情緒�����、性別����、語速和音高)以及精細的副語言特征��,這些特征包括插入笑聲��、呼吸��、以及強調某些詞語的能力�。

語音識別(ASR)和語音合成(TTS)技術廣泛應用在運營商裝維方向���,使得人機交互更加便捷�,提升了工作效率����,改善客戶服務��。

智能綜調語音技術應用場景

1.語音客服系統: 通過ASR實時將用戶的語音問題轉化為文字�����,結合自然語言處理(NLP)技術進行問題分類�����,TTS則用于將系統的應答結果轉化為語音反饋給用戶�。語音客服系統能夠自動處理常見問題�����,減少人工客服的負擔���。

2.故障診斷: 裝維人員可以通過語音描述故障現象���,ASR自動轉錄為文字并錄入系統�;系統可以利用文本分析和歷史故障數據進行初步診斷����,給出故障排查建議����。

3.工單語音錄入:裝維人員可以通過語音快速錄入工單信息�����,ASR將其轉化為結構化的文字內容����,錄入工單管理系統���?����?梢园ㄔO備狀態�、故障現象���、修復措施等內容�����。

4.智能綜調助手:用戶除了輸入文字給助手�����,可以直接語音錄入���,ASR模型將語音轉為文字后轉入下一個流程進行意圖識別��。

5.智能質檢:人工客服處理改約審核時快速的從錄音轉文字中獲取人員對話信息�����。

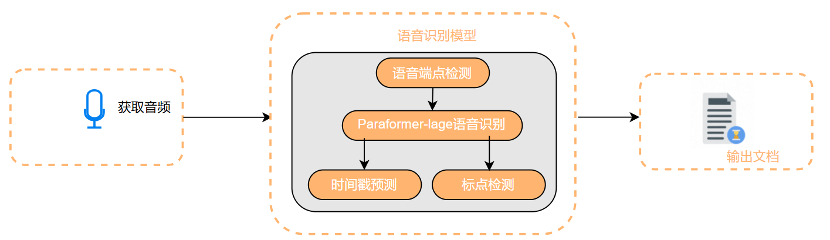

在實際使用中�,為了提高Paraformer模型的預測性能��,會在標準的Paraformer基礎上增加了語音活動檢測和時間戳預測模型�����。語音活動檢測采用基于前饋時序記憶網絡FSMN-VAD模型�,它能夠檢測有效語音的起始和結束���。為了提升ASR模型轉錄后文本的可讀性����,會對文本進行后處理���,包括添加標點符號和去除語音不流暢性���,采用的是FunASR提供的CT-Transformer模型���,它能夠在保證性能的同時利用快速解碼策略來最小化延遲���。

最終完整的FunASR語音識別模型處理流程如下圖所示:

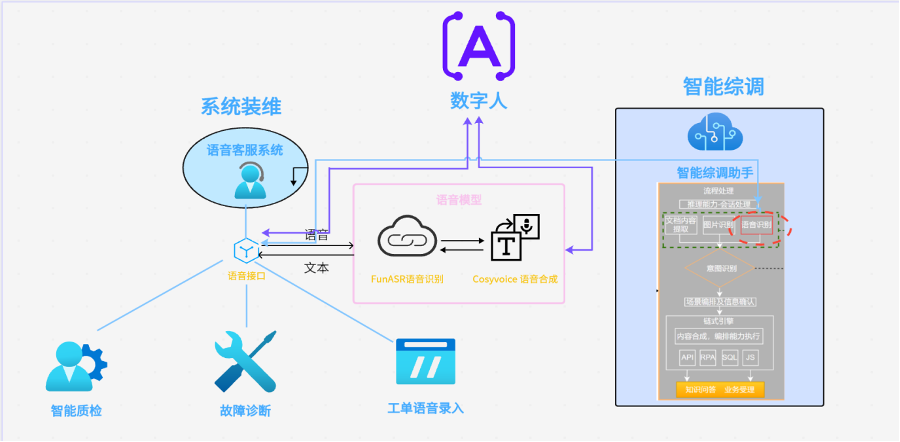

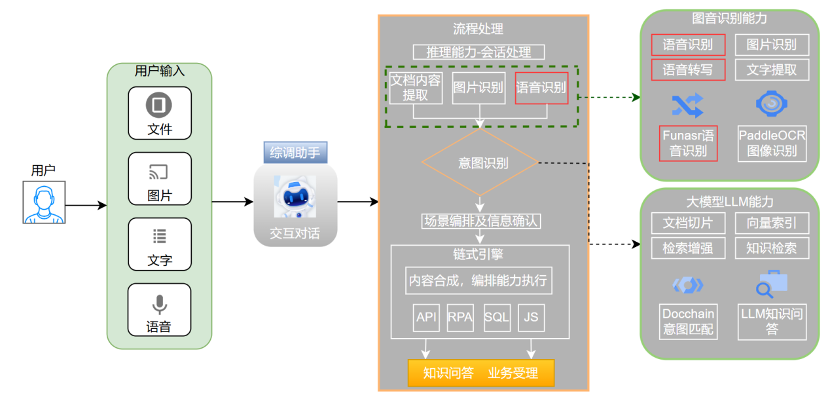

在業務受理流程中�����,采用大小模型結合�,多模態受理的方法���。比較典型的是在智能綜調助手應用中�,語音識別技術作為強有力的輔助工具���,提高了產品的人機交互能力和業務的整體運作效率����。語音模型將客戶語音需求轉為文字����,然后經過大小模型進行意圖判斷�����,匹配到適合場景的意圖后進入到鏈式引擎調用指定的API接口���,從而完成AI大模型在業務受理的智能化全過程�����。

大模型結合語音技術業務全流程

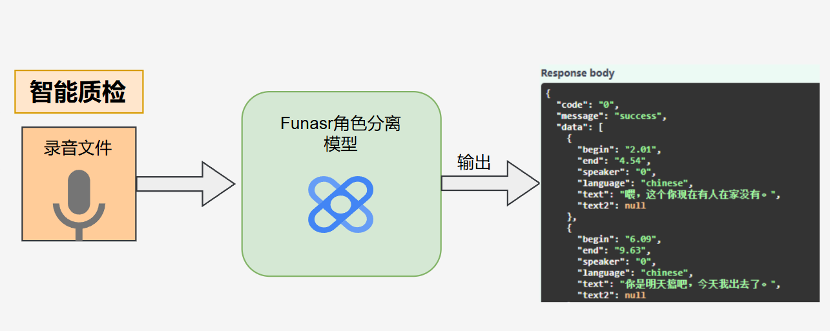

FunASR角色分離模型可用于智能質檢板塊�����。傳統方式下人工客服在處理改約審核時����,需要查看改約的圖片以及錄音��,當錄音較長時往往需要花費很多時間�,FunASR角色分離模型不僅可以識別語音��,還可以將多人對話區分���,這樣客服在審核時可以很快的了解到錄音的內容�����,并準確定位到說話人�。

使用FunASR對錄音文件進行角色分離的示例過程

模型訓練:個性化定制自己的語音模型

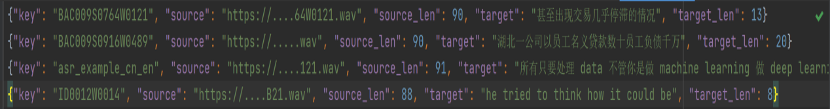

為了提升語音模型對地方方言的識別效果�����,需要對模型進行微調訓練��。FunASR官方提供簡便的模型訓練腳本�����,我們需要提前準備數據集并將數據集轉換為特定的格式以滿足模型輸入�����。FunASR模型訓練數據集的jsonl的格式如下圖所示:

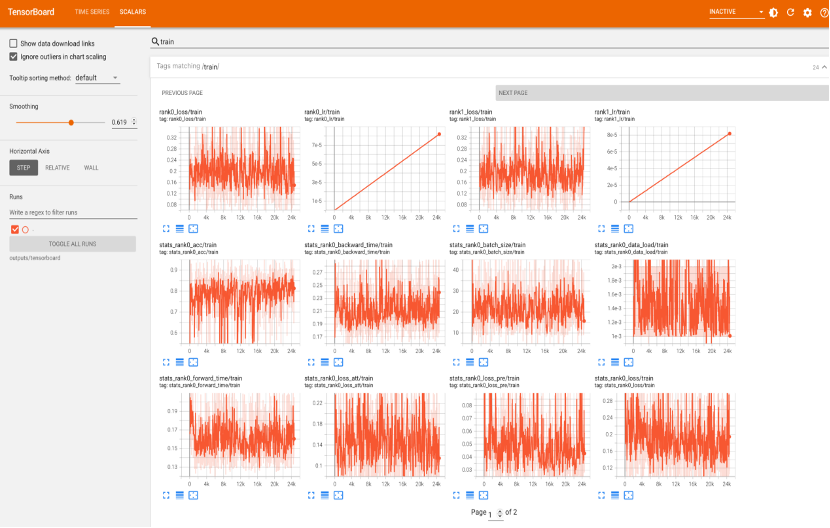

因為語音數據很多都長短不一���,為了充分利用計算資源又防止出現OOM�����,每一批樣本大小的選擇根據實際情況指定單張GPU上可以處理的最大幀數即token值�,訓練批次根據數據集情況而定�,其它的訓練參數保持默認即可�����,可以通過tensorboard可視化查看訓練過程��,如圖所示:

FunASR個性化語音訓練過程

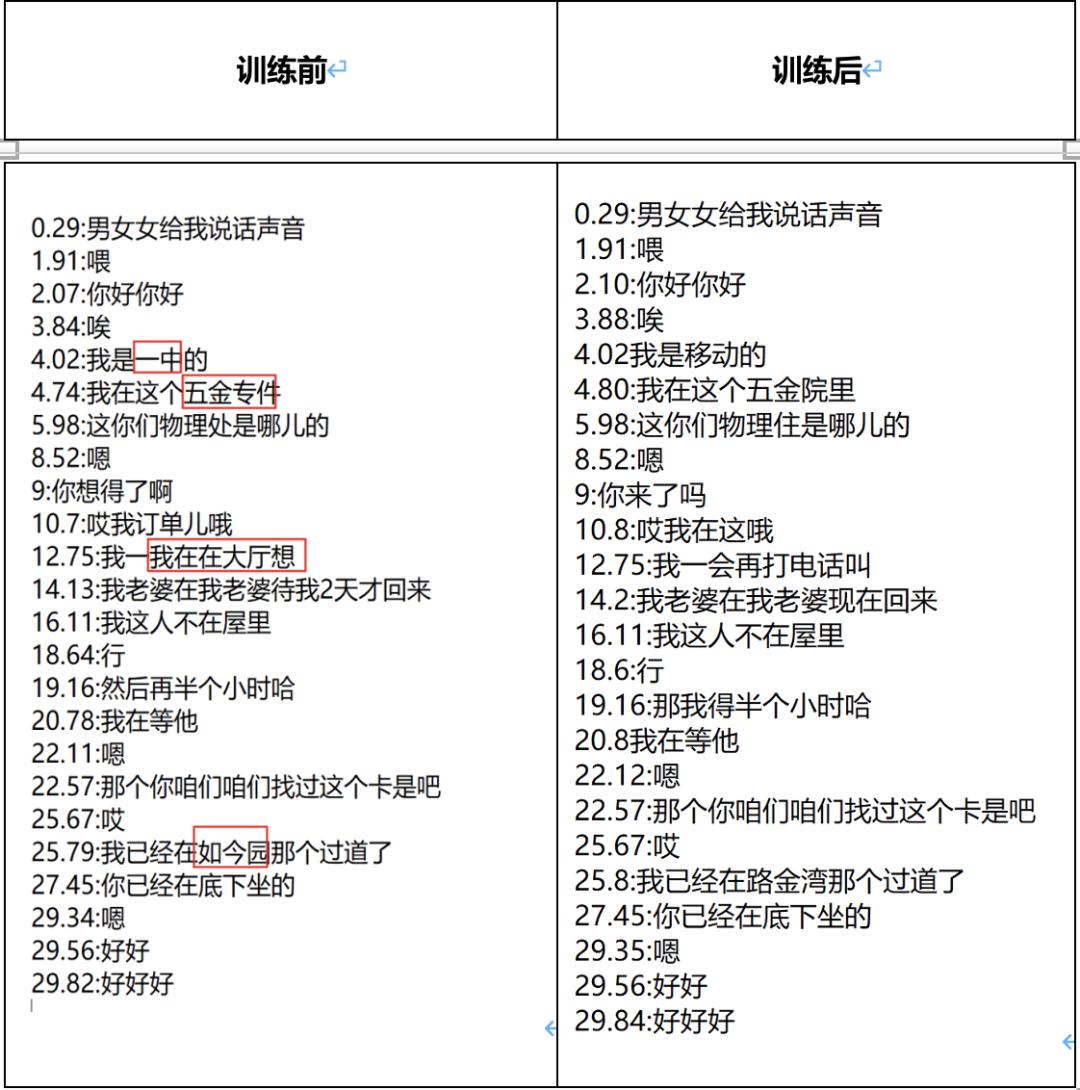

訓練前后效果對比:

可以看出模型訓練后對一些名詞的識別準確了很多�,比如微調前“移動”被識別為“一中”���,“五金院里”識別為“五金專件”��,“打電話”識別為“大廳”�����,“路金灣”識別為“如今園”等�����。

1.多語言多方言識別:在利用語音模型進行多方言訓練時��,音頻數據大多來源于裝維人員與客戶的通話錄音����,文本標注都是線下人員手動錄入�����,往往面臨訓練數據稀缺和數據采集錯誤的問題�����,這直接影響了模型的訓練效果���,導致模型在處理方言時準確性較低���。后續對于數據集的收集��,嘗試通過在互聯網上對一些公開的地方方言視頻進行語音文字的抓取���,然后通過后期整理����,優化數據�����。

2.背景噪音與環境因素:在嘈雜的環境中�����,語音識別的準確率通常會下降��,背景噪音����、回聲�����、多人同時說話等因素都會干擾模型的判斷�,導致錯誤識別�����,可以嘗試采用一些傳統的降噪技術比如利用python中的scipy 庫���,讓語音通過低通濾波器進行簡單的降噪����,然后再進行語音識別處理�����。

3.實時處理與低延遲需求:在實際業務需求中�����,為了不影響用戶體驗�,需要語音模型有較高的推理速度�,這對模型的計算效率和資源優化提出了較高的要求�。除了硬件方面的提升���,還可以在模型初步加載語音時���,采用異步的方式對語音文件進行切片����,然后再送入模型推理�,使其在多并發情況下也能保持良好的推理速度�����。

4.情感與語義理解:僅僅識別語音中的文字內容并不足夠����,很多場景還需要語音模型能夠理解說話者的情感和語義��。例如���,客服場景中�����,系統需要感知用戶是否處于焦慮��、憤怒等情緒�,以作出合適的回應�。

未來�,隨著數據規模的增長與計算資源的增強���,AI語音模型有望繼續突破瓶頸��,帶來更加自然和高效的語音交互體驗�����。期待在這一領域中�,更多創新的出現��,助力各行各業邁向智能化的新時代���。